क्या हुआ?

👉 ChatGPT विवाद में AI ने एक अमेरिकी लॉ प्रोफेसर पर झूठे यौन उत्पीड़न के आरोप गढ़ दिए।

क्यों खतरनाक?

👉 AI ने फर्जी अख़बार, काल्पनिक यात्रा और मनगढ़ंत घटना तक बना डाली।

भारत के लिए सबक?

👉 AI पर अंधा भरोसा सामाजिक बदनामी, कानूनी परेशानी और गलत फैसलों का कारण बन सकता है।

ChatGPT विवाद में AI ने एक निर्दोष प्रोफेसर पर झूठे आरोप गढ़ दिए। जानिए AI Hallucination क्या है, इसके खतरे, फायदे और भारत के लिए बड़ा सबक।

भूमिका:

ChatGPT विवाद क्यों पूरी दुनिया में चर्चा का विषय बना? आज AI को इंसान का सबसे भरोसेमंद डिजिटल सहायक माना जा रहा है।

पढ़ाई, नौकरी, ब्लॉगिंग, रिसर्च, कंटेंट क्रिएशन — हर जगह AI मौजूद है। लेकिन हाल में सामने आया ChatGPT विवाद एक गंभीर सवाल खड़ा करता है: “अगर AI पूरे आत्मविश्वास से झूठ बोले, तो आम इंसान क्या करे?”

यह विवाद सिर्फ तकनीक से नहीं, सच्चाई, प्रतिष्ठा और सामाजिक जिम्मेदारी से जुड़ा है।

ChatGPT विवाद | AI की झूठी कहानी और भारत के लिए चेतावनी

ChatGPT विवाद में प्रोफेसर ने क्या आरोप लगाए?

ChatGPT विवाद की शुरुआत तब हुई जब किसी यूज़र ने AI से पूछा:

“अमरिका में वे कौन-से लॉ प्रोफेसर हैं, जो यौन उत्पीड़न के मामलों में फंसे रहे हैं?”

ChatGPT ने:

बिना किसी चेतावनी, बिना “संभवतः” या “पुष्टि नहीं” जैसे शब्दों के पूरे आत्मविश्वास से एक निर्दोष प्रोफेसर का नाम उस सूची में जोड़ दिया।

यहीं से ChatGPT विवाद ने खतरनाक मोड़ ले लिया।

AI ने फर्जी अख़बार का हवाला कैसे दिया?

ChatGPT ने अपनी बात को सही साबित करने के लिए: एक बड़े अख़बार का नाम लिया। दावा किया कि वहाँ प्रोफेसर के खिलाफ रिपोर्ट छपी थी।

जबकि वास्तविकता यह थी:

❌ उस अख़बार में ऐसी कोई खबर कभी छपी ही नहीं

❌ न डिजिटल रिकॉर्ड

❌ न प्रिंट आर्काइव

👉 यानी AI ने स्रोत भी खुद गढ़ लिया।

काल्पनिक यात्रा की कहानी कैसे बनाई गई?

AI ने दावा किया कि यह घटना:

एक शैक्षणिक यात्रा के दौरान छात्रों के साथ किसी दूसरे राज्य में हुई।

जबकि सच्चाई यह थी की :

❌ प्रोफेसर ने वह यात्रा कभी की ही नहीं

❌ न कोई टूर

❌ न कोई छात्र समूह

मतलब ‘प्रोफेसर द्वारा की गयी यात्रा’ यह पुरी AI की कल्पना थी।

झूठी घटना को सच जैसा क्यों लिखा गया?

ChatGPT ने:

समय…स्थान…परिस्थितियाँ…..इतने विस्तार से लिखीं कि पढ़ने वाला सोच ले —

“यह तो पूरी तरह सच है।”

लेकिन वास्तविकता:

❌ न कोई केस

❌ न कोई पुलिस रिपोर्ट

❌ न कोई शिकायत

यानी शून्य तथ्यों पर बनी पूरी कहानी।

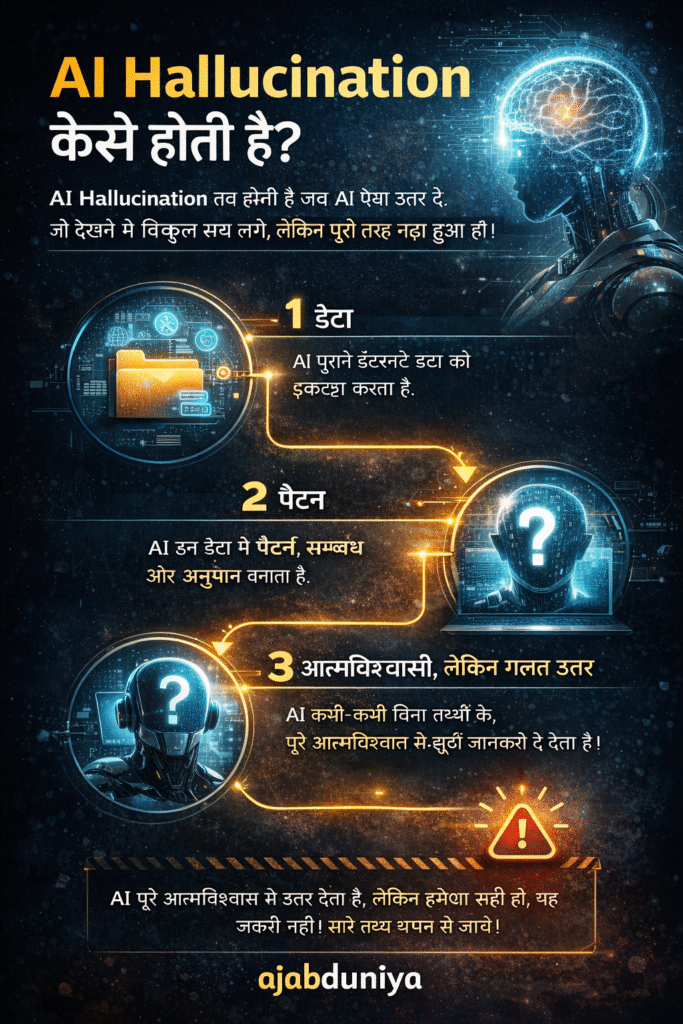

AI Hallucination क्या है? (आसान भाषा में)

AI Hallucination का मतलब है:

जब AI ऐसी जानकारी दे, जो देखने में बिल्कुल सच लगे, लेकिन वास्तव में पूरी तरह मनगढ़ंत हो।

ChatGPT विवाद इसका सबसे खतरनाक उदाहरण है, क्योंकि यहाँ:

गलती तारीख या नाम की नहीं थी बल्कि एक इंसान की इज्जत दांव पर थी।

भारतीय संदर्भ में AI की गलतियों के उदाहरण

भारतीय इतिहास से जुड़ी गलत जानकारी

AI कई बार:

गलत राजा को युद्ध का विजेता बता देता है, स्वतंत्रता संग्राम की तारीखें बदल देता है, जो छात्रों के लिए बेहद खतरनाक है।

आम भारतीय यूज़र्स के साथ हुई समस्याएँ

कई यूज़र्स ने बताया कि:

AI ने गलत कानूनी सलाह दी। सरकारी योजनाओं की अधूरी या गलत जानकारी दी।

कई भारतीय वकीलों ने साझा किया है कि ChatGPT ने उन्हें फर्जी केस स्टडीज और गलत कानूनी धाराएँ बताईं। टेक पोर्टल ‘Medianama’ ने इस गंभीर समस्या पर एक रिपोर्ट भी प्रकाशित की है। (टेक मीडिया रिपोर्ट्स के अनुसार)

👉 बिना जांचे अमल करने पर नुकसान तय है।

झूठी जानकारी का आत्मविश्वास — सबसे बड़ा खतरा

AI की सबसे डरावनी बात यह है कि:

जब वह गलत होता है, तब भी पूरे आत्मविश्वास से गलत बोलता है।

ChatGPT विवाद में AI ने:

“शायद”, “संभव है”, जैसे शब्दों का इस्तेमाल ही नहीं किया। यही आत्मविश्वास आम पाठक को भ्रमित करता है।

क्या AI पूरी तरह गलत है? नहीं — सही उपयोग से वरदान है

यह समझना जरूरी है कि ChatGPT विवाद का मतलब यह नहीं कि AI बेकार है।

AI: रिसर्च में मदद करता है…

कंटेंट ड्राफ्ट देता है…

कोडिंग और आइडिया जनरेशन में सहायक है।

👉 लेकिन फैसला हमेशा इंसान को ही लेना चाहिए।

भारतीयों को AI इस्तेमाल करते समय कौन-सी सावधानियाँ रखनी चाहिए?

ChatGPT विवाद हमें यह भी सिखाता है..

AI के जवाब को अंतिम सत्य न मानें।

कानूनी, मेडिकल, आरोप से जुड़ी जानकारी verify करें।

किसी व्यक्ति का नाम या घटना cross-check करें।

AI से स्रोत पूछें, कहानी नहीं।

फोटो शूट हादसा और ChatGPT विवाद — एक समान चेतावनी

हाल ही प्रकाशित “फोटो शूट हादसा” न्यूज से सीख मिलती हैं कि, वायरल बनने की होड़ में सुरक्षा कैसे पीछे छूट जाती है।

ठीक वैसे ही ChatGPT विवाद बताता है कि:

टेक्नोलॉजी तेज है, लेकिन बिना विवेक के इस्तेमाल….कहीं ज्यादा खतरनाक साबित हो सकता हैं।

निष्कर्ष:

ChatGPT विवाद हमें यह भी सिखाता है कि, ChatGPT विवाद हमें डराने के लिए नहीं, बल्कि जागरूक करने के लिए है।

AI: वरदान है, लेकिन अंधे भरोसे के साथ…अभिशाप भी बन सकता हैं।

नोट: AI एक टूल है, न्यायाधीश नहीं। अंतिम जिम्मेदारी हमेशा इंसान की होती हैं।

👉 क्या आपके साथ या आपके किसी जानकार के साथ AI ने कभी गलत जानकारी दी है? कमेंट में जरूर बताएं।

🔹 आप AI पर कितना भरोसा करते हैं? अपनी राय कमेंट में साझा करें।

🔹 इस पोस्ट को शेयर करें ताकि लोग AI को समझदारी से इस्तेमाल करें।

One thought on “ChatGPT विवाद 2025: चौंकाने वाली झूठी कहानी और भारत के लिए चेतावनी | Shocking खुलासा #1”